Chat GPT fa la spia alla polizia: attenzione a quello che chiedi | Finisci in manette

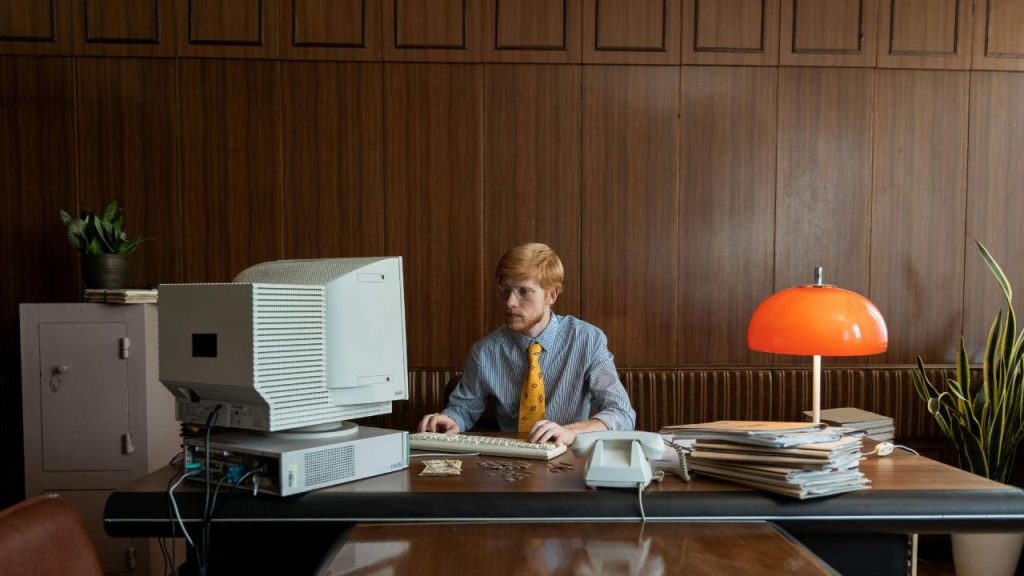

I sistemi di intelligenza artificiale possono chiamare le forze dell'ordine? Questa notizia potrebbe lasciarti senza parole. (Pexels Foto) - managementcue.it

I sistemi di intelligenza artificiale possono chiamare le forze dell’ordine? Questa notizia potrebbe lasciarti senza parole.

Il modello di intelligenza artificiale generativa sviluppato da OpenAI ha raggiunto la sua quinta versione, con miglioramenti evidenti nel ragionamento, nella comprensione contestuale e nella produzione di contenuti. Viene utilizzato per scrivere testi, analizzare dati, generare immagini e interagire a voce. L’accesso dipende dal piano attivo.

L’abbonamento Plus consente l’uso esteso di GPT-5, con funzionalità avanzate come modalità vocale, analisi documentale e generazione visiva. I limiti variano tra Free, Pro e Team. Le tariffe aggiornate sono consultabili sul sito ufficiale, con soluzioni pensate per singoli utenti e aziende.

Tra i rischi ci sono la gestione dei dati sensibili, la generazione di contenuti fuorvianti e le vulnerabilità informatiche. Le guide sulla sicurezza AI raccomandano di evitare l’inserimento di informazioni personali e di monitorare l’uso aziendale. La protezione dei dati è una priorità crescente.

L’intelligenza artificiale è integrata in app desktop, ambienti aziendali e piattaforme collaborative. Le API permettono personalizzazioni per compiti specifici. Le versioni 2025 sono strumenti per la condivisione schermo, la creazione di agenti personalizzati e l’interazione vocale. L’adozione professionale è in forte espansione. Quali sono i rischi?

Cosa troverai in questo articolo:

Gli aggiornamenti di Chat GPT

La quinta generazione del modello generativo segna un’evoluzione importante nel settore AI. Le novità includono risposte più naturali, maggiore coerenza linguistica e capacità di gestire compiti complessi. È disponibile in versioni Free, Plus, Pro e Team, ciascuna con strumenti dedicati.

L’espansione dell’intelligenza artificiale solleva interrogativi su sicurezza ed etica. Le vulnerabilità possono esporre dati sensibili, generare contenuti inappropriati o essere sfruttate per attacchi informatici. Le guide alla protezione consigliano di limitare gli input, monitorare le interazioni e formare gli utenti.

Il caso

In una foto pubblicata come post sul profilo Instagram @cronaca.italiana lo scorso 13 ottobre, la didascalia riporta: “Un ragazzo di 13 anni della Southwestern Middle School in Florida è stato arrestato dopo aver scritto su ChatGPT la frase ‘Come uccidere il mio amico in aula’ durante una lezione”. La richiesta avrebbe attivato i protocolli di sicurezza interni. Cosa sta succedendo e come funziona?

Come si è arrivati a chiamare le forze dell’ordine? “La segnalazione è arrivata da Gaggle, un sistema di sorveglianza scolastica che monitora gli account degli studenti e segnala contenuti potenzialmente pericolosi. Il ragazzo ha spiegato che si trattava di uno scherzo“. Il caso potrebbe lasciare senza parole, ma il controllo su quello che scrivi è importante per tutelarti.